Dass es ein künstliches Bewusstsein geben wird – daran zweifelt der Philosoph Metzinger nicht. Doch was bedeutet das für die Menschheit? Im Podcast Ethik Digital spricht der Philosoph über Leiden, Digitalisierung und die Kraft der Meditation.

Kategorie: Soziale Medien

„Made to Measure“: Die Doppelgängerin

Das Doku-Projekt „Made to Measure“ will untersuchen, ob man das Leben eines Menschen anhand seiner Google-Daten nachspielen kann. Das Experiment zeigt, wie wenig wir inzwischen noch überblicken, was Konzerne aus unseren Datenspuren alles herauslesen können.

Quelle: „Made to Measure“: Die Doppelgängerin

Dazu passt dieses Gespräch zwischen Wolfram Eilenberger und Adrian Daub über die geheimen Vordenker des Silicon Valley aus der tollen Gesprächsreihe „Sternstunde Philosophie“ des SRF (Schweizerisches Fernsehen): https://www.srf.ch/play/tv/sternstunde-philosophie/video/adrian-daub—die-geheimen-vordenker-des-silicon-valley?urn=urn:srf:video:ffa89a05-9cf3-42c0-9c11-bb6ee5529f1f .

Welche Philosophie steckt hinter Google, Facebook und Amazon? Es sind Intellektuelle wie Ayn Rand, Marshall McLuhan oder René Girard, auf die sich Tech-Ikonen des Silicon Valley gerne berufen. Der Literaturwissenschaftler Adrian Daub erklärt die philosophischen Wurzeln der digitalen Revolution.

Das innovative Zentrum der digitalen Revolution ist seit mehr als 50 Jahren das sogenannte Silicon Valley. Warum wurde ausgerechnet dieses schmale Tal im Norden Kaliforniens zum Ausgangspunkt der wohl grössten technischen Revolution der Menschheitsgeschichte? Welche Utopien waren dabei leitend? Welche Philosophinnen und Philosophen prägend? Diesen Fragen geht der in Stanford lehrende Literaturwissenschaftler Adrian Daub nach in seinem Buch «Was das Valley denken nennt. Über die Ideologie der Techbranche». Im Gespräch mit Wolfram Eilenberger legt Daub die Geister frei, die Tech-Ikonen wie Elon Musk, Mark Zuckerberg und Peter Thiel ins Leben riefen – und damit unseren Lebensalltag auch in Zukunft entscheidend prägen werden.

The Social Dilemma: wie Google & Co. uns verkaufen | Gert Scobel

Was bedeutet eigentlich Überwachungskapitalismus und wer profitiert davon – die User*innen oder die grossen Unternehmen des Silicon Valley? Vermutlich letztere, die aus dem „sozialen Dilemma“ der ersteren Kapital schlagen – facebook ist nicht nur ein Netzwerk unter Freund*inen, Google weit mehr als eine Suchmaschine. Die amerikanische Ökonomin, Philosophin und Sozialpsychologin Shoshanna Zuboff (die auch in der Dokumentation „The Social Dilemma“ zu Wort kommt) hat den Begriff des Überwachungskapitalismus geprägt. Was genau ist das – und vor allem, was bedeutet es für die User*innen sozialer Netzwerke? Der Überwachungskapitalismus ist ein Verfahren, in dem nicht mehr Gewinn durch Umwandlung von Ressourcen mit Hilfe von Arbeit in neue Produkte generiert wird, sondern die menschliche Erfahrung selbst zum Rohstoff gemacht wird. Hierbei werden durch informationsverarbeitende Technologien menschliche Erfahrungen in Verhaltensdaten umgewandelt und verkauft, was Konzerne zu Profit führt und ihnen mehr Kapital einbringt. Das Verhalten der Menschen im Netz und in den sozialen Netzwerken liefert Erkenntnisse. Die großen Unternehmen machen diesen Verhaltensüberschuss zu Gewinn, indem sie aus freiwillig gelieferten Daten Prognosen zum Verhalten in der Zukunft tätigen – und außerdem die User*innen manipulieren. Gert Scobel setzt sich mit Fluch und Segen der sozialen Medien auseinander – auch und grade hier, auf youtube.

Nils Melzer: „Vor unseren Augen kreiert sich ein mörderisches System“. — KRITISCHES NETZWERK

UN-Sonderberichterstatter Nils Melzer: „Vor unseren Augen kreiert sich ein mörderisches System“. von Herbert Ludwig / FASSADENKRATZER Der UN-Sonderberichterstatter über Folter (englisch UN Special Rapporteur on Torture and Other Cruel, Inhuman or Degrading Treatment or Punishment), Nils Melzer, warnt erneut eindringlich davor, dass investigativer Journalismus, der Kriegsverbrechen und andere Straftaten von Regierungen aufdeckt, von den USA…

Nils Melzer: „Vor unseren Augen kreiert sich ein mörderisches System“. — KRITISCHES NETZWERK – Subversiv & ablehnend gegenüber Imperialismus, Neoliberalismus, Ausbeutung Sozialdarwinismus, Überwachungsstaat, Desinformation

Du und Dein Smartphone: Du verrätst mehr über Dich, als Du Dir vorstellen kannst — StefanPfeiffer.Blog

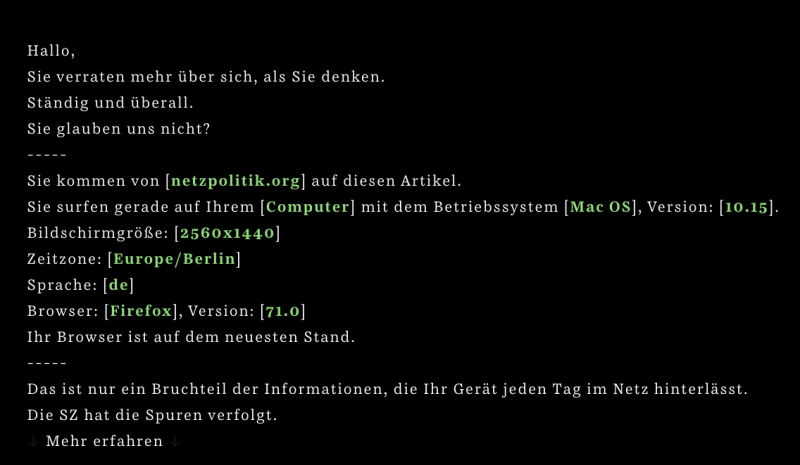

Hallo, Sie verraten mehr über sich, als Sie denken. Ständig und überall. Sie glauben uns nicht? So macht die Süddeutsche hier ein Onlinespecial unter dem Titel Verkauft und überwacht auf, das sich mit Datenschutz auf Smartphones auseinandersetzt. Danach wird dann dynamisch pro Anwender eingeblendet, welches woher man aus dem Netz kommt, welches Betriebssystem man benutzt […]

Du und Dein Smartphone: Du verrätst mehr über Dich, als Du Dir vorstellen kannst — StefanPfeiffer.Blog

Dressur des demokratischen Willens (Lars Jaeger)

Dressur des demokratischen Willens – Wenn Computeralgorithmen Wahlen entscheiden

28.3.2018

Die Mechanismen öffentlicher Aufmerksamkeitserregung und Empörung besitzen eine nicht immer einfach nachvollziehbare Dynamik. Verständlich ist dagegen, dass die Geschäftspraxis der Firma Cambridge Analytica starke öffentliche Abwehrreaktionen hervorrufen. Die Kommentare in Print- und Onlinemedien sind selten so einhellig wie in diesem Fall: Hier wurden die Grundregeln der Demokratie verletzt. Weniger verständlich ist der Zeitpunkt dieser Erregung. Das Gebaren der Firma mit ihrem so unheimlich wie schnöselig auftretenden Chef Alexander Nix waren längst bekannt (auch dass in deren Vorstand lange der ultrarechte Nazi-Sympathisant Steve Bannon sass und dass deren Hauptanteilseigner der Hedge Fonds-Manager Robert Mercer ist, der größte Spender der Trump-Kampagne). Wer es wissen wollte, konnte ohne weiteres in Erfahrung bringen, dass Nix und seine Leute mit Methoden des so genannten „Micro Targeting“ sowohl für Trump als auch für die Brexit-Kampagne aktiv waren und entscheidenden Anteil an ihren so überraschenden wie beklemmenden Wahlsiegen hatten. So dienten Cambridge Analytica und Micro Targeting beispielsweise in meinem Buch Supermacht Wissenschaft vom August 2017 als prominente Beispiele dafür, wie der technogische Wandel die Spielregeln unserer Gesellschaft verändert.

Ein breiter öffentlicher Diskurs über diese Praktiken setzt aber erst jetzt sein. So überrascht (und ernüchtert) man von der späten Reaktion unserer Medien, Politiker und Wirtschaftsführer auf den technologischen Wandel oft auch sein mag, so ermutigend ist, dass die volle Wucht der öffentlichen Entrüstung sich nun diesem Thema zuwendet. Es war höchste Zeit: Wie wir unterdessen mit Hilfe der modernen digitalen Technologien, Big Data und künstlicher Intelligenz (KI) manipuliert werden, bedarf einer breiten politischen und gesellschaftlichen Reaktion, die weit über ein blosses Achselzucken für die üblichen Lügen der grossen Internetfirmen wie Facebook oder Google, dass ihr Datensammeln über uns doch nur dem Allgemeinwohl diene und dass unsere Daten bei ihnen sicher seien, hinausgehen muss. Endlich reagiert die Politik, auch wenn es erst Video-Aufnahmen schlüpfriger Details im Geschäftsgebaren von Cambridge Analytica bedurfte, um dafür den Anstoss zu geben. Denn nicht die skandalöse Manipulation des öffentlichen Willen mit Hilfe von KI und Big Data waren es, die Alexander Nix zum Rücktritt von seinem Posten zwangen, sondern das Bekanntwerden der von seiner Firma verwendeten jahrhundertealten Manipulationstechniken von Sexfallen („honey traps“) und Denunziation.

Bereits vor einiger Zeit prahlten Nix und seine Firma damit, über psychologische Daten von „ca. 220 Millionen Amerikanern mit vier bis fünftausend Datenpunkten für jeden einzelnen von ihnen“ zu verfügen und damit im Jahr 2014 Einfluss auf 44 politische Wahlen in den USA genommen zu haben (was auch eine Zusammenarbeit mit Trumps neuem Rechtsaussen-Sicherheitsberater John Bolten umfasste). Und 2017 war die Firma nach eigenen Angaben massgeblich am Wahlsieg Uhuru Kenyattas beteiligt. Der Kenyattas Wahlsieg vorangegangene Wahlkampf war wie kaum eine Wahl je zuvor von Fake news und Fehlinformationen geprägt, die über Smartphones und soziale Medien ihre Verbreitung fanden.

Die Methode, Daten für politische Zwecke auszunutzen, ist keineswegs neu. Seit Jahrhunderten versuchen Wahlkämpfer die Persönlichkeiten, politischen Ansichten und Neigungen der Wähler zu bestimmen und diese Information zum Nutzen ihrer Kandidaten zu verwenden. Doch zweierlei ist neu und wird die zukünftige Architektur der politischen Macht in demokratischen Gesellschaften massgeblich prägen: das schiere Volumen der verwendeten Daten und die immer intelligenteren Algorithmen, die zwecks Manipulation der Wähler eingesetzt werden. Dass dabei Facebook mit all den Daten, die die Firma über uns sammelt, eine massgelbliche Rolle spielt (aber auch Google, Microsoft und Apple), ist nun endlich in der öffentlichen Diskussion angekommen.

Wie stark wir bereits heute mit Hilfe von Big Data und KI-Algorithmen durchleuchtet werden, ist nur den wenigsten Menschen bekannt. Eine besonders ergiebige Datenquelle für KI-Anwendungen zur Bestimmungen unserer Eigenschaften sind die „Likes“ auf Facebook. Gemäss Studien des Psychometrik-Experten Michal Kosinski innerhalb seines Projektes „myPersonality“ lässt sich aus durchschnittlich 68 Likes eines Users mit Hilfe eines entsprechenden KI-Algorithmus mit 95-prozentiger Treffsicherheit vorhersagen, welche Hautfarbe, mit 88-prozentige Wahrscheinlichkeit, welche sexuelle Orientierung und mit 85 Prozent Treffsicherheit, welche politische Orientierung diese Person hat. Aber auch Dinge wie Drogenkonsum, Religionszugehörigkeit und sogar Intelligenzquotient und Familienverhältnisse in der Kindheit lassen sich so ermitteln. Kosinski behauptet: Sein Algorithmus kann anhand von zehn Facebook-Likes Charakter und Verhalten einer Person besser einschätzen als ein durchschnittlicher Arbeitskollege, mit 70 Likes besser als ein Freund, mit 150 besser als die Eltern und mit 300 Likes besser als deren Lebensgefährte. Und mit noch mehr Likes kann die Maschine sogar die Person bei ihrer Selbsteinschätzung übertreffen. Ein weiteres Beispiel für die Macht der Daten: im Frühjahr 2016 beschrieb der KI-Experte Eric Horvitz von Microsoft Research, wie ein Computerprogramm allein anhand öffentlich verfügbarer Daten zu dem Schluss kommen kann, welche Personen in Zukunft mit einer gewissen Wahrscheinlichkeit Opfer bestimmter Krankheiten werden. Horvitz zeigte zum Beispiel auf, wie intelligente Algorithmen aus Twitter- und Facebook-Meldungen einzelner Nutzer eine beginnende Depression erkennen können – noch bevor der Betroffene selber davon weiss.

Spätestens hier sollte jedem klar sein, dass diese Fähigkeiten von KI und Big Data ein gewaltiges Gefahrenpotential bergen. Denn von Kenntnis unserer Persönlichkeit ist es nur ein kurzer Weg zur Beeinflussung unseres Verhaltens, im politischen Zusammenhang, wie wir wählen. Dass wir mittels Algorithmen und Big Data beeinflussbar sind, zeigt bereits der gewaltige kommerzielle Erfolg Facebooks. Wäre dem nicht so, könnte Facebook mit personalisierter Digital-Werbung nicht Dutzende von Milliarden Dollar verdienen. Spätestens seit der Brexit-Abstimmung und der US-Präsidentenwahl 2016 ist aber klar, dass KI auch in politischen Auseinandersetzungen und demokratischen Wahlkämpfen eine immer bedeutendere Rolle spielt. Algorithmen wie der von Michal Kosinski lassen sich nämlich auch umgekehrt benutzen: Zur Suche nach bestimmten Profilen, beispielsweise nach ängstlichen, frustrierten oder zornigen Arbeitnehmern, nach Waffennarren und Rechtsextremen – oder auch: nach unentschlossenen Wähler. Und von dort ist es nicht mehr weit, Menschen zu manipulieren und sie in ihrem Wahlverhalten zu beeinflussen. So lassen sich die mit Hilfe von KI erstellten Profile dazu verwenden, jedem Wähler seine eigene auf ihn gemünzte Botschaft zukommen zu lassen. Potenziellen Clinton-Wählern – Latinos und Afroamerikaner, skeptische Liberale und Linke, junge Frauen – wurden 2016 massenweise „Nachrichten“ zugesandt, inklusive schamloser Lügen, über die Interessenkonflikte der Clinton-Stiftung oder angeblicher illegaler Machenschaften der demokratischen Präsidentschaftskandidatin, mit dem Ziel, sie davon abzuhalten, Hillary Clinton zu wählen. Zu diesem Zweck wurden computergenerierte automatisierte Skripte eingesetzt, so genannte „Bots“, die eine grosse Menge künstlich generierten Contents in sozialen Medien wie Twitter und Facebook veröffentlichten. Empfängliche User wurden so systematisch mit propagandistischen Beiträgen und dreisten Lügen bombardiert (z.B. dass der Papst Trump unterstütze oder dass Hillary Clinton einem Ring von Kinderpornografen vorstehe). Es gab sogar „Hispanic bots“, die vorspiegelten, für die Mehrheit der Latinos zu sprechen und Trump zu unterstützen (wobei allseits bekannt war, dass sich die Latinos in grosser Mehrheit gegen ihn waren). All diese Massnahmen zeigten Erfolg: die ländlichen Wählerschaft (traditionell republikanische Wähler) verzeichnete signifikante Zunahmen, afroamerikanische Stimmen dagegen einen Rückgang. Und unerwarteterweise wählten ein Drittel der Latinos Trump, trotz zahlreicher öffentlichen Beschimpfungen dieser Gruppe von seiner Seite.

Dies alles ist aber erst der Anfang, so Horvitz. Wie schnell und vor allem wie leicht die Algorithmen sozialer Medien uns zu extremen Positionen bringen und die Radikalisierung junger Menschen fördert, zeigt ein Experiment des französischen Informatikers Kave Salamatian. Dieser legte zahlreiche Scheinprofile bei Facebook an und liess studentische Mitarbeiter verschiedene Nachrichten und Informationen mit harmlosen Themen mit Likes markieren. Nach drei Tagen hatten die Mitarbeiter ihren Teil zum Experiment beigetragen. Von jetzt an liess Salamatian die Accounts automatisch jeden neuen Freund akzeptieren und jeden Beitrag, der ihnen präsentiert wurde, mit „Gefällt mir“ beantworten. Das Ergebnis war so erstaunlich wie unheimlich: Nach weiteren drei Tagen hatten zehn der Accounts direkten Kontakt zum terroristischen IS, erste Recruiter meldeten sich bei den „Schützlingen“.

Auch in Bezug auf die Verwendung unserer Daten für kommerzielle oder politische Zwecke ist der Skandal um Cambridge Analytica wohl nur die Spitze eines schnell wachsenden Eisbergs. Unzählige weitere Firmen haben via Facebook Zugang zu unseren Daten. Und eine wohl noch grössere Macht als Facebook hat der Internet-Riese Google: Sollte die Firma in Zukunft beispielsweise einen bestimmten Präsidentschaftsbewerber ausbooten wollen, könnte sie kurzerhand die Algorithmen modifizieren und so seinen Nutzern nur entsprechend gefilterte Informationen zukommen lassen. Mit diesen Möglichkeiten der Einflussnahme, wie sie die grossen amerikanischen Internetfirmen besitzen und wie sie von skrupellosen Firmen wie Cambridge Analytica ausgenutzt werden, steht unsere Demokratie selbst auf dem Prüfstand. Die digitale Revolution hat längst ihr Immunsystem angegriffen und unser Ortungssystem für richtig und falsch, für wahre oder fake News durcheinandergebracht.

Die Menschen taten sich immer schon schwer, mit neuen Medien kritisch umzugehen. Wir amüsieren uns zu Tode, prophezeite bereits in den 1980er Jahren der Philosoph Neil Postman (und beschrieb damit unsere Verhältnis zum TV). Aus heutiger Sicht eine geniale Vorwegnahme der Entwicklungen – auch wenn Postman die manipulative Kraft der sozialen Medien noch nicht kannte. Und man kann noch weiter zurückgehen: Das neu entwickelte Radio war in den späten 1920er und 1930er Jahren ein wesentliches Propagandainstrument der Nazis.

Dass Algorithmen der künstlichen Intelligenz massiv auf unsere alltägliche Erfahrung, das soziale Leben und das politische Geschehen Einfluss nehmen, dämmert uns so langsam. Doch die Tragweite dieser Entwicklung haben wir noch bei weitem nicht erfasst. Längst fordern KI-Experten wie Horvitz eine entsprechende Gesetzgebung, die als „ein wichtiger Teil der rechtlichen Landschaft der Zukunft helfen soll, Freiheit, Privatsphäre und das Allgemeinwohl zu bewahren.“

Tiziana Cantone: Suicide following years of humiliation online stuns Italy – BBC News

How did Italy view the suicide of a young woman whose sex videos spread over the internet?

Source: Tiziana Cantone: Suicide following years of humiliation online stuns Italy – BBC News

TV-Kritik: Supernerds: Was passiert mit uns bei der Digitalisierung? – TV-Kritik – FAZ

TV-Kritik: Supernerds: Was passiert mit uns bei der Digitalisierung? – TV-Kritik – FAZ.

Webcams, Theater und Julian Assange: Mit einem Experiment leuchtete der WDR einige Abgründe der schönen neuen vernetzten Welt aus. Dass nicht alles klappte, ist egal. Denn der Sender riskierte etwas – inhaltlich und formal.

29.05.2015, von Frank Lübberding

© WDR/Schauspiel Köln/Oliver Abraham ![]() Supernerds-Regisseurin Angela Richter und Wikileaks-Gründer Julian Assange

Supernerds-Regisseurin Angela Richter und Wikileaks-Gründer Julian Assange

„Wir sind die Guten und fragen um Erlaubnis“, so der Journalist Richard Gutjahr; das machten aber „nicht alle so.“ Um diesen Satz drehte sich ein so interessantes wie lehrreiches Experiment im WDR. Im „Supernerds-Überwachungsabend“ ging es um die Konsequenzen der Digitalisierung.

Die Stichworte hat jeder schon einmal gehört. Es geht um das Sammeln der unzähligen digitalen Spuren, die wir jeden Tag hinterlassen. Um die Erstellung von Persönlichkeits- und Bewegungsprofilen, schließlich um die Überwachung unserer Aktivitäten durch die Geheimdienste. Nur haben wir das alles auch schon verstanden? Oder stolpern wir nicht mit unserem analog geprägten Hirn in diese schöne neue Welt, ohne uns über die Konsequenzen klar zu sein?

Sind Einblicke in die Privatsphäre selbstverständlich?

Aus dieser alten Welt stammt auch noch der Antagonismus von „gut“ und „böse“. Gutjahr erwähnte ihn, als es darum ging, ob der WDR die Computerkameras der Zuschauer nutzen darf. Sie zeigen den Zuschauer beim Zuschauen. Das ist mittlerweile so selbstverständlich geworden, dass sich niemand mehr groß Gedanken über einen solchen Zugriff auf die eigenen Privatsphäre macht. Ist das jetzt schon „gut“, weil der WDR um Erlaubnis fragt? Im Gegensatz zu den bösen Buben, die ohne viel Mühe Handys und Computer zum perfekten Spionagegerät umfunktionieren? Oder dokumentiert sich in dieser Selbstverständlichkeit nicht schon längst jener Strukturwandel in der digitalisierten Gesellschaft, der uns am Ende zu anderen Menschen machen wird?

Noch vor wenigen Jahrzehnten wäre niemand auf die Idee gekommen, dem Rest der Menschheit einen Blick in die eigenen vier Wände zu erlauben; selbst dann nicht, wenn man höflich gefragt hätte. Heute lassen sich viele Menschen freiwillig überwachen. Und das lag sicher nicht daran, weil sie ein junger Mann höflich um Erlaubnis bat.

Alles, was möglich ist, wird auch gemacht

Genau darum geht in der digitalisierten Gesellschaft: Wie sich unsere Lebenswelt verändert und sie sich den technologischen Bedingungen anpasst. Alles, was möglich ist, wird auch gemacht. Auf dieser Logik beruhte auch das Konzept der Sendung. Der „Überwachungsabend“ setzte auf das, was man mit dem digitalen Baukasten am besten kann: Daten zu verknüpfen, um ein Gesamtbild herzustellen. Das ging bis in die künstlerischen und journalistischen Formen hinein.

Es passierte zeitgleich unendlich viel: Ein Theaterstück im Kölner Schauspielhaus namens „Supernerds“. Einspieler zum Thema und Interviews mit Experten. Dazu die heute unvermeidliche Interaktivität mit dem Zuschauer vor Ort und vor den Bildschirmen. Die beiden Moderatoren, außer Gutjahr noch Bettina Böttinger, versuchten diese Teile vor dem Auseinanderfallen zu bewahren. Der Überwachungsabend wurde so zum Sinnbild für das heutige Multitasking. Sicher hat der eine oder andere Zuschauer noch nebenbei Fußball gesehen. Man will überall zugleich sein.

Julian Assange, überlebensgroß

An diesem Punkt wurde aber deutlich, wo das Problem liegt. Es ist eben keineswegs nur der hypertrophe Sicherheitsstaat, der mit der Chiffre 9/11 den Kampf gegen den Terror zu seinem zentralen Existenzzweck machte. Whistleblower wie Edward Snowden ermöglichten uns erst den Blick hinter die Kulissen dieses neuen Behemoth. Gestern Abend wurde der Wikileaks-Gründer Julian Assange live interviewt. Er erschien virtuell und überlebensgroß auf der Bühne des Kölner Schauspiels. Assange wirkte wie ein freier Mensch – und stand doch bloß in seinem kleinen Zimmer in der Botschaft Ecuadors in London. Er kann mit jedem Menschen auf der Welt reden, ist aber in Wirklichkeit eingesperrt. Seine Lebensbedingungen sind schrecklich. Ihm nützt die Freiheit nichts, gestern Abend live auftreten zu können.

Das war durchaus symbolisch. Das reale Gefängnis verträgt sich gut mit der Freiheit in der digitalen Gesellschaft. Nur baut man sich seinen Knast gleich selbst. Der Überwachungsabend versuchte das mit verschiedenen Experimenten anschaulich zu machen. Etwa wie man aus wenigen Informationen von einem Menschen viel über diesen erfahren kann. Oder wie das Kommunikationsverhalten einen Blick in das Wesen dieses Menschen erlaubt. Das reicht von Konsumpräferenzen bis zu sexuellen Vorlieben. Dabei ist man nur einen Klick weit davon entfernt, sich selbst zum Spitzel in eigener Sache zu machen. Die Möglichkeiten zum digitalen Einbruch sind bekanntlich vielfältig. Gutjahr demonstrierte aber am Beispiel von Überwachungskameras, was passiert, wenn man digitale Türen offen lässt. Viele senden ihre Bilder unverschlüsselt, selbst wenn sie eigentlich nur ihren Säugling beim Schlafen im Auge behalten wollen. So kann jeder zusehen, nicht nur die Eltern.

1 | 2 Nächste Seite | Artikel auf einer Seite

Der dritte Kreis der Hölle: Dave Eggers’ „Der Circle“ im Vergleich mit Huxley und Orwell

Der dritte Kreis der Hölle: Dave Eggers’ „Der Circle“ im Vergleich mit Huxley und Orwell.

Dave Eggers’ „Der Circle“ Der dritte Kreis der Hölle

Normierung war einmal Sache der Polizei, in Dave Eggers’ Roman „Der Circle“ übernimmt es das Individuum selbst. Was verbindet und was trennt diese Dystopie von Orwells „1984“ und Huxleys „Schöne neue Welt“?

09.08.2014, von ANDREAS BERNARD

Es ist ein Kennzeichen der Gegenwart, dass Handlungen, die im 20. Jahrhundert unweigerlich auf autoritäre Staaten bezogen wurden, heute freiwillig und im Zeichen der Individualität geschehen. Auf dem Gebiet der Reproduktionsmedizin haben Verfahren wie die Pränatal- oder Präimplantationsdiagnostik dazu geführt, dass kaum noch Kinder mit Behinderungen geboren werden; besorgte Elternpaare lösen längst jenes prekäre Versprechen ein, das die Eugeniker in der ersten Hälfte des 20. Jahrhunderts nur forderten. In den Sozialen Netzwerken pflegen die Benutzer Tag für Tag ihre „Profile“ und teilen der Community per GPS-Signal die neuesten Joggingerfolge oder ihren Aufenthaltsort im Nachtleben mit – lauter Techniken der Wissenserzeugung also, die ursprünglich zur kriminologischen Erfassung abweichender Subjekte entwickelt wurden („Profile“ gab es mehr als hundert Jahre lang nur von Wahnsinnigen und Serienmördern, Ortungsdienste kamen zum Einsatz, um nach entflohenen Straftätern zu fahnden).

Die beiden berühmtesten Schreckensvisionen der Weltliteratur im 20. Jahrhundert spielen genau solche Szenarien totalitärer Unterdrückung durch, von der Empfängnis bis zum Tod. Aldous Huxleys „Schöne neue Welt“ von 1932 handelt von einem autoritären Weltstaat, der Liebe und sexuelle Fortpflanzung unter Strafe stellt und seine Untertanen durch künstliche Erzeugung in Flaschen fabrikgleich produziert. George Orwells „1984“, gut 15 Jahre später erschienen, entwirft das Bild eines Regimes, das seine Bevölkerung durch omnipräsente Bildschirme überwacht und gleichschaltet. Nun erscheint Dave Eggers’ „The Circle“ auf Deutsch, und in den Debatten, die das Buch in den Vereinigten Staaten ausgelöst hat, wurde es immer wieder in die Tradition dieser dunklen Klassiker gestellt.

© picture-alliance / akg-images

© picture-alliance / akg-images ![]() Die düstere, klar erkennbare Dystopie: Szene aus einer Verfilmung von George Orwells „1984“

Die düstere, klar erkennbare Dystopie: Szene aus einer Verfilmung von George Orwells „1984“

Drei literarische Dystopien, drei Geschichten von einem allmächtigen Gebilde, das seine Umwelt tyrannisiert – und es ist so entscheidend wie verstörend, dass Eggers, dessen Roman sich (bewusst oder intuitiv) stark an die Vorbilder Aldous Huxleys und George Orwells anlehnt, zunächst aus genau entgegengesetzter Perspektive erzählt, aus einer Sphäre der Freiheit und Selbstverwirklichung. In „Schöne neue Welt“ und „1984“ war vom ersten Satz an klar, dass man es mit einem repressiven politischen System zu tun hat (das Huxley als Reaktion auf die eugenischen Forschungen seines Bruders Julian, Orwell unter dem Einfluss des gerade zu Ende gegangenen Zweiten Weltkriegs erschuf).

„Der Circle“ dagegen beginnt in einer beinahe vertrauten Gegenwart, deren demokratische Verfassung immer wieder betont wird, in der Zentrale eines fiktiven Internet-Unternehmens, das nur konsequent zusammenführt, was Google, PayPal, Facebook oder Twitter seit eineinhalb Jahrzehnten unabhängig voneinander getan haben. Mit dem Social-Media-Konzept „TruYou“ hat die Firma Circle alle Konkurrenten überflüssig gemacht: „ein Konto, eine Identität, ein Passwort, ein Zahlungssystem pro Person. Schluss mit mehrfachen Identitäten. Ein einziger Button für den Rest deines Onlinelebens.“ Der Roman begleitet seine Hauptfigur, Mae Holland, bei ihrem heißersehnten Eintritt in den Konzern und ihrem Aufstieg durch die Hierarchien.

Was genau musste geschehen, dass die Internet-Community Nordkaliforniens, entstanden aus dem Geist der Hippies und der 68er-Kultur, von einem Roman in die Nähe totalitärer Regime gerückt wird? Auf den ersten Blick kann es ja keine verschiedenartigeren Konzepte geben: Der Circle ist ein soziales, humanitär engagiertes Unternehmen; seine Geschäftsmodelle feiern Individualität und unterdrücken sie nicht wie der Weltaufsichtsrat in „Schöne neue Welt“ oder der „Gedankentrust“ in „1984“. Dennoch entfalten die auf alle Gänge und Wände des Hauptquartiers projizierten Leitlinien–„Leidenschaft, Partizipation, Transparenz“ – nach und nach eine beklemmende und tyrannische Macht. Aus Freiwilligkeit wird Zwang, aus Aufklärung Despotismus, aus Einzigartigkeit Konformität, und die letzten Außenseiter, die sich diesem Terror der Sichtbarkeit widersetzen wollen, brechen zusammen oder kommen ums Leben, wie Maes engste Vertraute im Unternehmen und ihr ehemaliger Freund.

1 | 2 | 3 Nächste Seite

Yvonne Hofstetter: Der Angriff der Intelligenz | ZEIT ONLINE

Yvonne Hofstetter: Der Angriff der Intelligenz | ZEIT ONLINE.

„Wir brauchen eine Treuhandstelle für Algorithmen“, sagt Yvonne Hofstetter, Expertin für Künstliche Intelligenz. Sonst drohe eine Herrschaft intelligenter Maschinen.

Yvonne Hofstetter, aufgenommen am Münchner Flughafen | © Christine Brandl

Yvonne Hofstetter, erfolgreiche Unternehmerin und Expertin für Künstliche Intelligenz, warnt vor einer heraufziehenden Herrschaft der Maschinen. „Wenn sich alles zum Schlechten entwickelt, dann werden intelligente Maschinen unsere Zukunft so sehr vorherbestimmen, dass der Mensch seine Entscheidungsfähigkeit verliert“, sagt sie im Interview mit der ZEIT. Diese Systeme können „unsere Freiheit einschränken“.

Hofstetter entwickelt mit ihrem Unternehmen Teramark seit mehr als zehn Jahren intelligente Software-Systeme für die Rüstungsindustrie und für zivile Unternehmen. Sie kennt viele Anwendungsfälle für Künstliche Intelligenz und beschreibt die Entwicklung der Software als Evolution im Zeitraffer. Ihre Fähigkeiten nähmen rasant zu. In ihrem neuen Buch Sie wissen alles, das am 15. September erscheint, beschreibt sie anhand von praktischen Beispielen die Macht intelligenter IT-Systeme – und ihre bedrohlichen Schwächen.

Ein System gelte als intelligent, „wenn es ein Verhalten zeigt, das vom Programmierer ursprünglich nicht so vorgesehen wurde. Es trifft Entscheidungen, die man nicht in all ihren Abzweigungen und Konsequenzen durchdacht und festgelegt hat. Ich bin der Meinung, dass Systeme, die lernfähig sind und einen Plan, eine Strategie entwickeln können, als intelligent gelten müssen“.

Solche IT-Systeme gäbe es bereits, sie seien etwa im Aufklärungsflugzeug Awacs im Einsatz und an den Finanzmärkten. Aktuell würden aber vor allem die großen Internetkonzerne in Künstliche-Intelligenz-Systeme investieren. Hofstetter sagt: „Google ist ein Musterbeispiel. Der Konzern hat durch Zukäufe viele Basistechnologien für intelligente und selbst lernende Systeme erworben: Lernverfahren, Roboter, Sensorik, selbst Drohnen und Satelliten. Zunächst ist das nicht mehr als Technologie. Doch daraus werden neue Produkte und Dienstleistungen mit viel Künstlicher Intelligenz entstehen, Maschinen, die selbstständig neue Informationen wie unsere Bewegungsprofile und Alltagsgewohnheiten zusammentragen und verarbeiten. Mit noch mehr Daten lernen sie, uns noch besser zu analysieren und aktiv zu beeinflussen.“

Deutschland und Europa brauchen eine Aufsichtsbehörde

Hofstetter schätzt den Komfort, den diese Technik mit sich bringt, sagt aber: „Derartige Systeme sind ein Angriff auf die Autonomie des Menschen. Sie funktionieren nur auf der Basis unterbrechungsfreier Totalüberwachung.“

Aus ihren Erfahrungen mit intelligenter Software zieht Hofstetter den Schluss: „Wir haben noch rund fünf Jahre Zeit, eine Balance zwischen den Internetunternehmen und den Verbrauchern herzustellen.“ Es sei grundsätzlich möglich, Künstliche-Intelligenz-Systeme so zu programmieren, dass sie keinen Schaden anrichten. „Aber dies geschieht in der Regel nur, wenn man politischen Einfluss auf die Programmierung hat. Die ganz großen Datenbestände und Technologien für die Auswertung dieser Daten liegen derzeit aber in ganz wenigen Händen, die kein Datenschützer beaufsichtigen kann.“ Deshalb ist die Unternehmerin überzeugt, dass Deutschland und Europa eine neue Aufsichtsbehörde gründen müssen. „Wir brauchen eine Treuhandstelle, eine Aufsicht für Algorithmen.“